Los rápidos adelantos en las tecnologías GAN presionan a los usuarios a estar más atentos en cuanto al origen y veracidad de los contenidos que consumen

El lanzamiento de Midjourney V5 —el sistema de IA para la creación de imágenes hiperrealistas usando GAN— abrió una nueva puerta a la desinformación porque las imágenes producidas por este sistema y la velocidad con las que pueden ser creadas ponen a competir a usuarios, verificadores y desinformantes en una carrera desigual.

La tecnología GAN se nutre de la información aportada por el usuario para producir contenidos específicos solicitados por éste y, a la vez, “aprende” de las elecciones o correcciones del usuario con el fin de que sus resultados sean cada vez más precisos.

“Una red antagónica generativa (GAN) es un modelo de aprendizaje automático (ML) en el que dos redes neuronales compiten entre sí para ser más precisas en sus predicciones. Las GAN generalmente se ejecutan sin supervisión y utilizan un marco de juego cooperativo de suma cero para aprender”.

Kio Networks

Con esta tecnología es posible crear tanto imágenes realistas, como videos que pasarían como reales hasta para un ojo bien entrenado.

“Deepfake (un acrónimo de «aprendizaje profundo » y «falso») se refiere a medios sintéticos en los que una persona en una imagen o video existente se reemplaza con la imagen de otra persona”.

Wikipedia

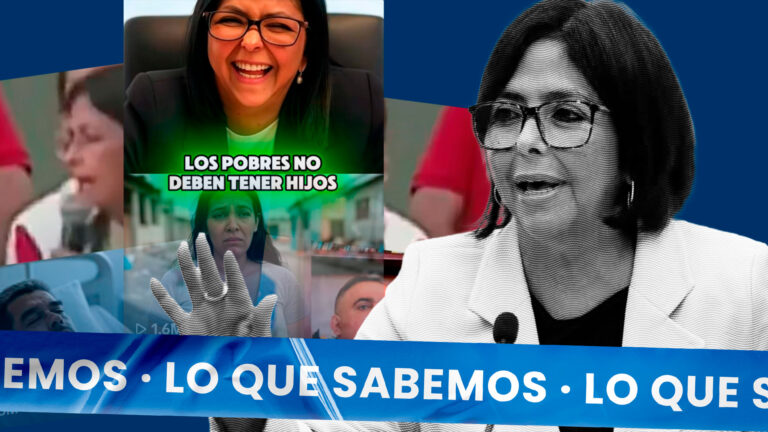

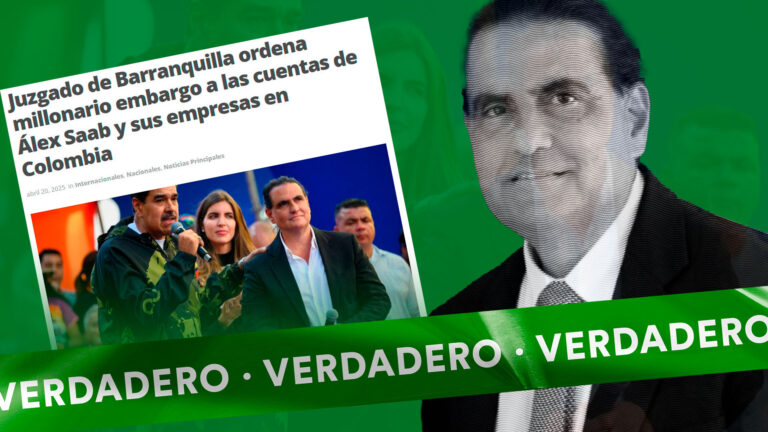

En varias oportunidades, Cazadores de Fake News ha alertado acerca del uso del deepfake para desinformar y cómo es posible detectar imágenes o videos de personas —aparentemente reales— creados con inteligencia artificial.

Aparte de la imagen de Maduro y Trump estrechando sus manos en una reunión que nunca se dio, generada con Midjourney V5 a petición de Cazadores de Fake News para fines educativos, las redes sociales se llenaron de imágenes falsas generadas con esta tecnología que, si bien pudieron nacer con fines de entretenimiento, tienen potencial para convertirse en desinformación.

Putin y Xi-Jinping

Una imagen del presidente ruso Vladimir Putin arrodillado frente a su homólogo chino Xi-Jinping, está circulando en Twitter —aprovechando la agenda conjunta de ambos líderes en Mariupol— junto con mensajes que sugieren la sumisión de Rusia a China.

“ÚLTIMA HORA #Putin de rodillas, jurando obediencia y lealtad a su amo y comandante #Xi”.

Texto del bulo

Sin embargo, la imagen muestra indicios evidentes de que fue generada con inteligencia artificial: el desenfoque en la línea del cabello de Xi-Jinping, la ausencia de cuello en el cuerpo de Putin, el desnivel en la columna de la pared que se ve detrás de Putin y el contraste entre la alta calidad de la imagen en general con la falta de definición en las manos del hombre que está detrás a la izquierda de los mandatarios.

Esta fotografía fue publicada por primera vez el pasado 20 de marzo —sin ningún contexto— en la galería de Imgur de un usuario que suele publicar contenido de comedia y sátira y, a partir de allí, migró a Twitter y otras redes sociales donde le dieron el giro desinformativo que ha sido desmentido.

“Pasé la imagen por un detector de imágenes de IA creado por Hugging Face, una empresa de tecnología francesa que proporciona herramientas para el aprendizaje automático y el desarrollo de software. Según su detector de imágenes, la foto es artificial”.

Amanda Florian, periodista colaboradora en CNN y The Washington Post

El falso arresto de Trump

Un set de varias imágenes del ex presidente norteamericano Donald Trump siendo arrestado también está siendo compartido en las redes sociales. En todas las imágenes se ve a la figura de Donald Trump forcejeando con supuestos policías que intentan detenerlo, corriendo para escapar de ellos y hasta siendo enjuiciado.

Las imágenes que se han hecho virales forman parte de un set de aproximadamente 50 fotografías que Elliot Higgins, fundador del colectivo de OSINT Bellingcat, generó usando Midjourney V5 con base en un posible hecho real, ya que esta semana se esperaba que Trump fuera acusado por el fiscal de distrito de Manhattan, Alvin Bragg, sobre un supuesto pago a la estrella de cine para adultos Stormy Daniels.

“Haciendo imágenes del arresto de Trump mientras espero que arresten a Trump”

. Elliot Higgins

Las imágenes generadas por Higgins provocaron que la moderación de Midjourney V5 lo expulsara de la plataforma y eliminara también la palabra “arresto” de las instrucciones para generar imágenes, ante la posibilidad de que sea usada con fines desinformativos.

El bot generador de inteligencia artificial Midjourney prohibió a Eliot Higgins, el fundador del colectivo de periodistas de fuente abierta Bellingcat, el miércoles (…) Midjourney también prohibió el uso de la palabra «arresto» en las instrucciones”. Washington Examiner

La inducción de la Ira

Las tecnologías de IA permiten la creación de cualquier tipo de imágenes, incluso la invención de obras que nunca existieron pero que conservan características comunes a un período específico de la historia del arte, como es el caso de “La inducción de la Ira”.

“La inducción de la ira” • Óleo sobre lienzo • Alrededor de 1890 • Maxwell Alexander Irving”.

Varios usuarios de Twitter agregaron contexto a la supuesta pintura de Irving, lo que provocó que la plataforma colocara una alerta sobre la autenticidad de la imagen.

“Esta es una imagen generada por IA, no una composición original hecha por humanos. Las manos de las figuras lo delatan, ya que los generadores de imágenes de IA han sido propensos a crear representaciones inexactas de las manos”.

Twitter

Las fotos que Alejandra nunca se tomó

La periodista de CNN, Alejandra Oraa, generó un grupo de fotografías de ella misma usando IA con el fin de alertar a su comunidad en Instagram acerca de los riesgos de estas tecnologías en cuanto a la desinformación.

“Es muy importante como consumidores ser conscientes y tener una percepción de lo que se está consumiendo, ya sea una marca, una experiencia o una afiliación con una entidad o político”.

Alejandra Oraa

Poco dinero, poco tiempo

Ethan Mollick, un profesor de negocios en la Escuela Wharton de la Universidad de Pensilvania, también generó un deepfake de sí mismo en video usando una plataforma de inteligencia artificial.

“Con solo una fotografía y 60 segundos de audio, ahora puedes crear un deepfake de ti mismo en cuestión de minutos combinando algunas herramientas de inteligencia artificial baratas. Lo he probado yo mismo, y los resultados son alucinantes, incluso si no son completamente convincentes”.

Ethan Mollick

El profesor usó ChatGPT para generar un guion con la instrucción “lo que Ethan Mollick diría sobre el espíritu empresarial”, luego usó otra herramienta que —a partir de un minuto de audio proporcionado por él— produjo la narración de lo que luego sería un video generado a partir de una fotografía suya.

“Soy alguien que en realidad es bastante profesional en esta tecnología en muchos sentidos. Pero también creo que no estamos preparados para las implicaciones sociales de poder engañar a la gente a gran escala… La idea de que podrías hacer esto para cualquiera es una especie de fenómeno nuevo”.

Ethan Mollick

¿Se puede verificar que una imagen es creada con IA?

A medida que se desarrollan y perfeccionan las tecnologías de IA, también se desarrollan y perfeccionan las habilidades de las personas y las herramientas para detectarlas.

Hive Moderation es una herramienta sencilla y de uso gratuito que permite detectar contenidos generados con IA. Basta con copiar y pegar un texto o cargar el medio (imagen, video, audio, etc.) a la página para que el sistema evalúe su origen y arroje un veredicto que puede orientar al consultante.