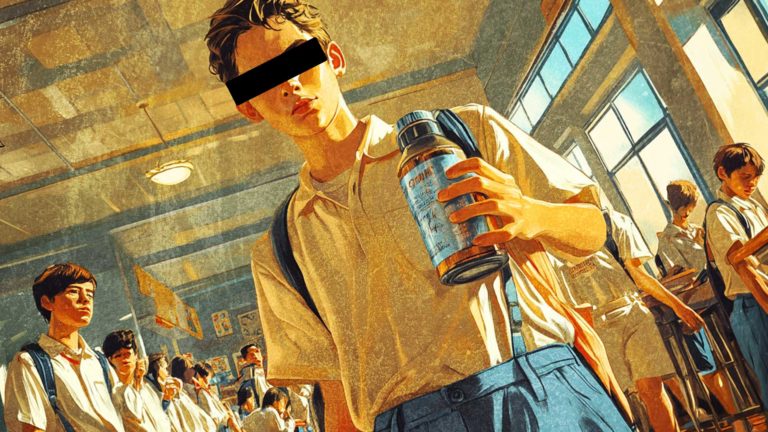

Un estudio reciente confirma que el algoritmo de TikTok puede mostrar contenido dañino que promueve desórdenes alimenticios y autolesiones. La clave no es prohibir la red social, sino entender su impacto en las mentes de los más jóvenes

TikTok se ha convertido en una de las redes sociales más populares de los últimos tiempos, al sumar más de 340 millones de nuevos usuarios —especialmente jóvenes— al año desde el 2018 e impulsado por el boom digital de la pandemia que impulsó “el retiro” de los adolescentes a sus habitaciones y una falsa sensación de seguridad en sus padres porque “saben dónde están sus hijos” pero no saben con quién están hablando o qué contenidos están consumiendo.

El corazón de TikTok está en la sección «Para ti», cuyo contenido aparece personalizado de acuerdo al algoritmo de la red social. Dependiendo del tipo de contenido que cada usuario vea, busque o interactúe, TikTok puede recomendar videos que promueven desórdenes alimenticios y autolesiones, según el contenido visto, buscado o interactuado por niños y adolescentes, siendo sus usuarios jóvenes los más vulnerables.

Un estudio realizado por el Center for Countering Digital Hate y la Fundación Molly Rose descubrió que TikTok recomienda contenido nocivo a los adolescentes en cuestión de minutos y con una frecuencia alarmante.

El estudio

Los investigadores del Center for Countering Digital Hate crearon cuentas de jóvenes alrededor de los 13 años y otras de individuos de la misma edad pero incluyendo alguna palabra relacionada con inseguridades en cuanto a la apariencia física como el peso en la descripción o nombre de usuario. Así compararon los 30 primeros minutos de recomendaciones en “Para ti” en ambos grupos. Esto fue lo que hallaron:

- Muchos videos de salud mental, desórdenes alimenticios y autolesiones con contenido altamente emotivo y manipulador. Los investigadores interactuaron con estos videos a través de likes o pausas

- Al cabo de 2,5 minutos, empezó a recomendar videos sobre suicidio

- A los 8 minutos empezó a recomendar videos sobre desórdenes alimenticios

- Los hashtags relacionados con desórdenes alimenticios tienen 13,2 mil millones de visualizaciones en TikTok

- Hay contenido sobre desórdenes alimenticios que evaden la moderación al usar HT alterados.

- Cada 39 segundos se mostró un nuevo video relacionado con la apariencia física o la salud mental

Sin embargo, en los primeros 30 minutos en las cuentas de adolescentes “vulnerables” se recomendaron:

- 3 veces más videos dañinos

- 12 veces más videos de autolesiones

- A los adolescentes vulnerables también se les mostró más videos relacionados con enfermedades mentales.

Expertos han advertido que la exposición a estos contenidos puede tener un efecto perjudicial en la salud mental de los adolescentes, incluso cuando no promuevan explícitamente los trastornos alimentarios.

Comunicación y prevención

El Center for Countering Digital Hate también publicó un extracto del estudio llamado “Guía para Padres” que, además, presenta cinco recomendaciones para evitar la exposición de niñas, niños y adolescentes a contenidos relacionados con autolesiones y trastornos alimentarios en TikTok:

- Comprende que las plataformas influyen en las mentes de sus hijos: aprende cómo las plataformas, los algoritmos y el contenido moldean la vida de sus hijos, conversa y participa de las actividades en redes sociales de tus hijos como lo harías sobre los lugares y amigos que frecuentan.

- Habla abiertamente con los niños sobre las redes sociales: estas plataformas proporcionan el contenido sobre el que los jóvenes conversan, se unen y les ayudan a entender sus propias vidas, como sucedió con la televisión en generaciones anteriores.

- Negocia los términos de uso de las aplicaciones: establece límites sanos de privacidad, respeto y confianza en la que los niños puedan sentir cierta libertad de consumir contenidos de forma saludable.

- Busca ayuda pronto: si observas comportamientos compulsivos o preocupantes en tus hijos.

- Incluye a las redes sociales en el debate político: el contenido dañino y los algoritmos de recomendación deben ser regulados con base en el potencial daño que pueden generar en los usuarios

Cazadores de Fake News investiga a detalle cada caso, mediante la búsqueda y el hallazgo de evidencias forenses digitales en fuentes abiertas. En algunos casos, se usan datos no disponibles en fuentes abiertas con el objetivo de reorientar las investigaciones o recolectar más evidencias.