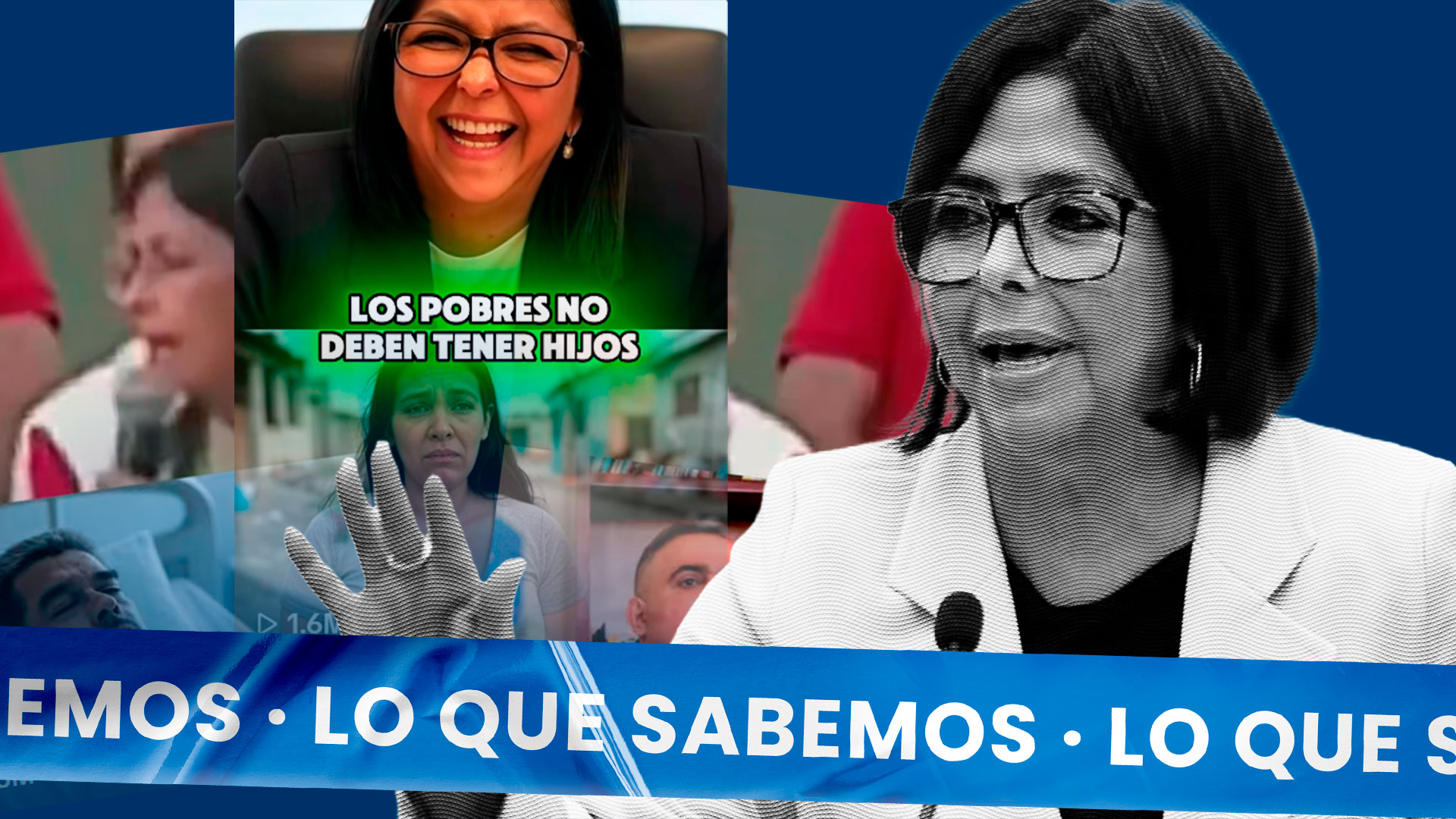

Desde el pasado 19 de marzo, se han detectado seis cuentas en TikTok que difunden información falsa relacionada con Delcy Rodríguez. Entre los audiovisuales que han circulado, se menciona la muerte de Nicolás Maduro, prohibición del uso del dólar, la eliminación de las pensiones, así como supuestas leyes que prohíben los tatuajes o tener más de dos hijos en Venezuela

Dos de estas cuentas parecen tener relación entre sí. Sin embargo, todas tienen otros patrones en común: solo habían publicado los videos desinformativos con la imagen de la vicepresidenta, alterados con herramientas de Inteligencia Artificial generativa; al ser detectadas las cuentas únicamente tenían uno o dos videos y, a pesar de eso, acumulaban más de 10.000 seguidores y decenas de miles de likes, lo que sugiere que podrían tener seguidores comprados o que las cuentas fueron compradas, o cedidas por un dueño anterior.

El 16 de abril, el equipo de Cazadores de Fake News, detectó una cuenta en TikTok con más de 16 mil seguidores. Para ese momento, sólo había publicado dos videos que involucran falsos anuncios realizados por Delcy Rodríguez, ambos creados a partir de una alocución del 8 de enero de 2025.

El primer video se refiere a la supuesta muerte de Nicolás Maduro, fue publicado el 12 de abril y sus reproducciones superan más de 3,4 millones. El segundo clip habla sobre la falsa prohibición de los tatuajes en Venezuela, y fue desmentido por el equipo de verificadores de Efecto Cocuyo el pasado 19 de marzo de 2025 en su sección Cocuyo Chequea, fue subido a la plataforma el 12 de abril y cuenta con 3,4 millones de reproducciones.

Posteriormente, se encontraron otras dos cuentas de TikTok que solo tenían en sus perfiles dos videos de Delcy Rodríguez: uno con la prohibición del uso del dólar, con 3,6 millones de reproducciones, que había sido creado a partir de un discurso el 5 de noviembre de 2024. Mientras que la otra pieza, sobre la eliminación de las pensiones en Venezuela —creada con el video de la acusación de Rodríguez del pasado 10 de marzo de 2025 a ExxonMobil por presuntamente sacar a Chevron de Venezuela— acumulaba 664 mil reproducciones.

Estas dos cuentas presentan imágenes de perfil muy similares entre sí y sus nombres de usuario hacen referencia a canciones virales de la década del 2000. Cocuyo Chequea, también desmintió el bulo en el que la funcionaria prohibió el uso y la tenencia de la moneda estadounidense en Venezuela, con una pena de 20 años con la eliminación de los dólares, el video fue arrojado a la cuenta el 22 de abril de 2025.

Mientras que la verificación realizada con el audiovisual de la eliminación de las pensiones a los jubilados, por el equipo de Efecto Cocuyo, menciona que, al contrario de la desinformación, Rodríguez presentó en mayo de 2024 un proyecto de ley para proteger el beneficio, el cual entró en vigencia ese mismo mes.

Un quinto bulo que presenta imágenes de Delcy Rodríguez creadas con IA, fue desmentido por el equipo de Efecto Cocuyo y menciona la supuesta ley que prohíbe tener más de dos hijos. A diferencia de los anteriores, éste no usa el video de un discurso de la vicepresidenta, si no que es hecho a base de una fotografías creadas con herramientas de IA. El video fue subido a TikTok el 19 de marzo por un usuario distinto a los anteriores y cuenta con más de 821 mil reproducciones. La cuenta continúa activa y ha seguido cargando videos a la plataforma.

Aunque muchos de los videos han sido eliminados de las cuentas originales, –presumiblemente por restricciones de la plataforma en cuanto al uso de herramientas de IA para alterar videos reales y desinformar–, los bulos siguen siendo compartidos tanto en TikTok como en otras plataformas por usuarios que los descargaron.

Transformación “a la mexicana”

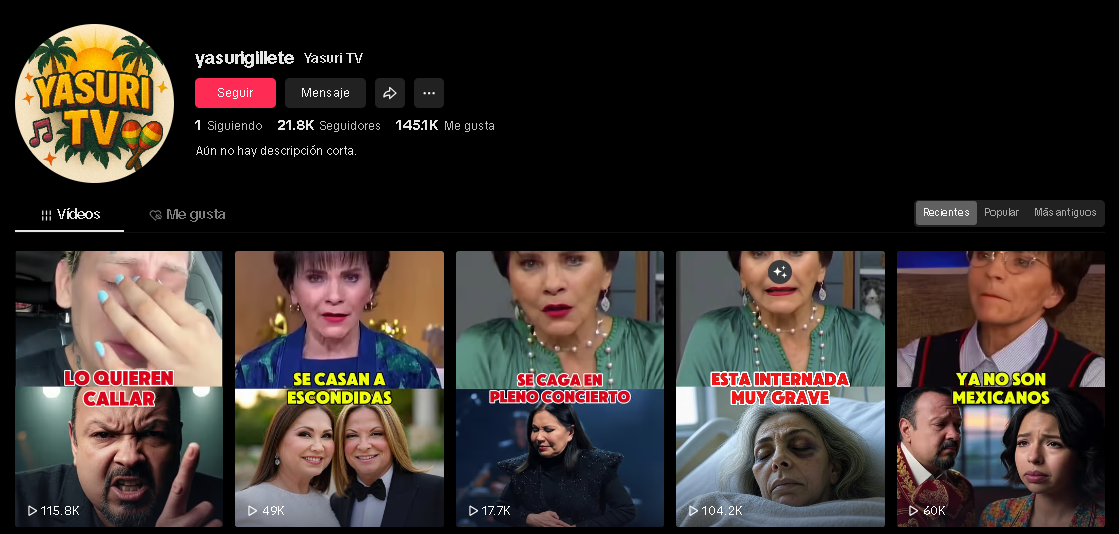

Las verificaciones de Cocuyo Chequea también documentan que las dos cuentas con imágenes de perfil similares y nombres satíricos de canciones, tienen otro punto en común: luego de los vídeos creados con IA con falsos anuncios hechos por Delcy Rodríguez, publicaron contenidos relacionados con el mundo del espectáculo mexicano.

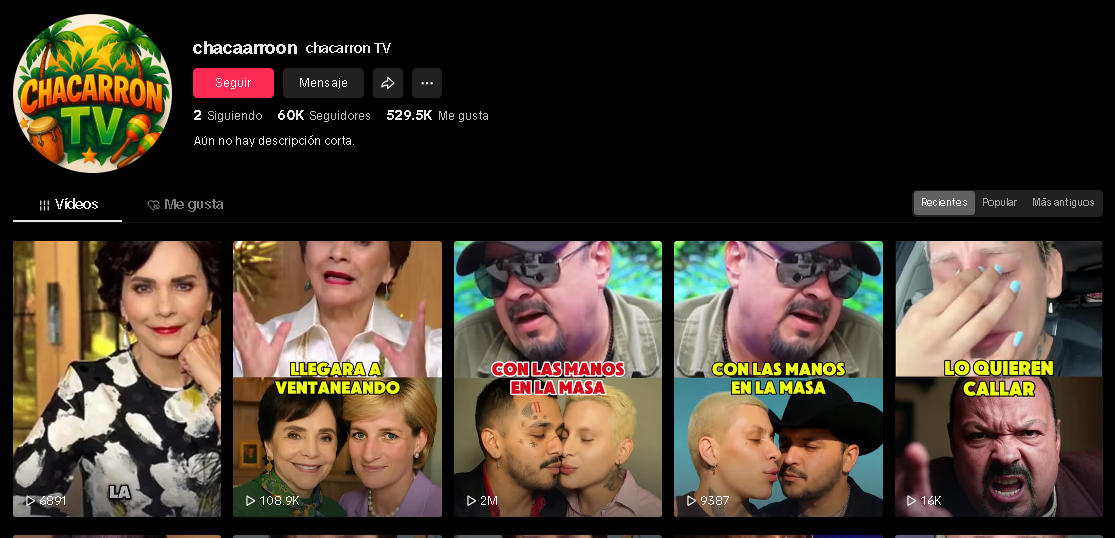

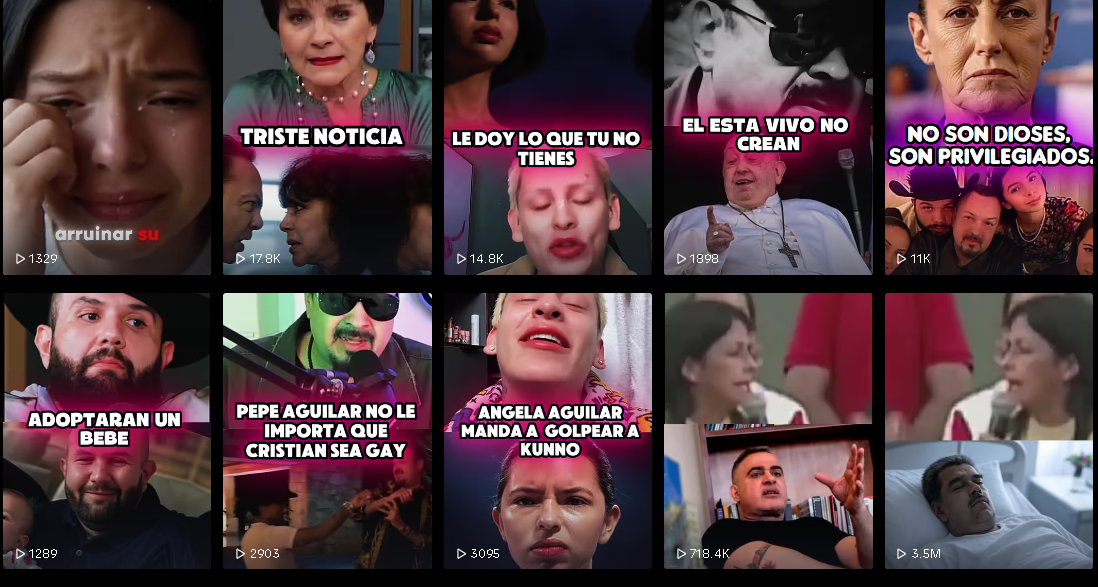

Estas dos cuentas cuyos nombres hacen referencia a canciones humorísticas virales, de origen panameño, de principios de la década de los 2000: Yasuri Gillete y Chacarrón, podrían estar escudándose en contenido satírico para justificar la publicación de información falsa o engañosa, disfrazada de humor. Ambos usuarios primero publicaron las desinformaciones sobre Rodríguez, y luego pasaron a publicar videos sobre artistas y, en general, el mundo del entretenimiento mexicano y latinoamericano. Actualmente, en ninguna de las dos cuentas se aprecian los vídeos de la vicepresidenta, aunque pueden verse las copias guardadas acá y acá.

Y aunque ambas publicaron sobre la falsa eliminación de bonos y pensiones para jubilados, así como la falsa prohibición del uso del dólar durante abril, fue otra cuenta con un nombre también irónico la que publicó los primeros bulos generados artificialmente.

Este caso se repite en otra cuenta encontrada que, el 12 y el 19 de marzo, se estrenó con tres videos sobre las falsas leyes contra los tatuajes y tener más de dos hijos en Venezuela, que Cocuyo Chequea desmintió acá y acá, con entre 840 mil y 3,6 millones de visualizaciones, pero desde entonces como hicieron las cuentas estudiadas, publicaron videos sobre farándula mexicana.

Además, esta cuenta había publicado vídeos sobre falsas muertes de Diosdado Cabello, María Corina Machado y Nicolás Maduro, que borró posteriormente, o que fueron eliminados por la plataforma.

Otra cuenta de TikTok, que hizo eco de la falsa ley contra tener más de dos hijos, realizó la misma práctica. Después de uno o varios vídeos contra Delcy Rodríguez, publicó decenas de otros videos generados con Inteligencia Artificial con farándula mexicana y latinoamericana. En este caso, varios de los vídeos tienen el sello del canal televisivo Telemundo y para el 28 de abril de 2025 aún tenía publicado su primer vídeo desinformativo, sobre el falso anuncio de Delcy Rodríguez prohibiendo a las venezolanas tener más de dos hijos.

Eugenio Derbez, Ana Gabriel, Ricky Martin, Shakira, Christian Nodal y la presidenta Claudia Sheinbaum son algunas de las personalidades que han sido objeto de desinformación, especulación y mentiras por estas cuentas, tras el gancho inicial con los vídeos de Delcy Rodríguez.

Esto revela una novedosa práctica de utilizar declaraciones polémicas falsas de la funcionaria venezolana como cebo o carnada para acumular millones de visualizaciones y seguidores desprevenidos, a pesar de la forma irónica de nombrar a las cuentas de TikTok, con intereses económicos o propagandísticos.

Inteligencia artificial: progresos y desafíos

Cazadores de Fake News ya ha documentado como algunos software de IA han sido utilizados para distorsionar a figuras políticas, como el caso de las fotografías de Edmundo González Urrutia y María Corina Machado portando armas de fuego que fueron creadas con Aurora, el modelo de generación de imágenes de Grok, el chatbot de la red social X.

Las mejoras en la tecnología de IA han facilitado las posibilidades de que cualquier usuario con conocimientos técnicos mínimos pueda crear deepfakes, lo que aumenta el riesgo de desinformación, pudiendo provocar confusión y escepticismo en los usuarios de redes sociales.

Las imágenes creadas con IA son una de las técnicas de desinformación, que se han viralizado con más fuerza desde que Midjourney puso a disposición del público su versión V5 en marzo de 2023.

Los riesgos asociados a los generadores de imágenes con inteligencia artificial quedaron en evidencia con el caso del falso arresto de Donald Trump, en el que se utilizaron de forma descontextualizada 50 imágenes creadas como experimento por Eliot Higgins, periodista especializado en investigación de fuentes abiertas y fundador de Bellingcat. Higgins había generado las imágenes para ilustrar las primeras aplicaciones de herramientas de inteligencia artificial generativa en la desinformación. El incidente llevó a que la plataforma Midjourney le revocara el acceso y restringiera la creación de imágenes de personas reales.

Otro caso de desinformación creada con herramientas de IA generativa documentado en Venezuela es el falso noticiero “House of News Español”. Un supuesto medio de comunicación creado en YouTube en enero del 2023, con falsos presentadores creados con IA que difundían narrativas favorables al gobierno de Nicolas Maduro.

Nuevos modelos, nuevos riesgos

La creación de imágenes de personas reales o famosas con herramientas de IA se había visto restringida hasta el 27 de marzo de 2025 cuando el CEO de OpenAI, Sam Altman anunció en su cuenta de X el lanzamiento de un creador de imágenes desde ChatGPT, distinto a Dall-E, gratuito para cualquier usuario. A partir de ese momento, miles de personas han usado esta herramienta para recrear imágenes, lo que ha incrementado los riesgos de seguridad y amenazas en el uso de datos biométricos que quedan almacenados en la plataforma.

En el caso de los videos con los falsos anuncios de Delcy Rodríguez, se puede apreciar que la voz fue generada con inteligencia artificial, al igual que la sincronización de los movimientos de su boca y manos. Sin embargo, se trata de registros de alocuciones anteriores, a los que solo se les manipuló el gesto facial y la voz. Además, hasta la fecha no existen fuentes oficiales que corroboren ninguno de los cinco anuncios.

Cazadores de Fake News investiga a detalle cada caso, mediante la búsqueda y el hallazgo de evidencias forenses digitales en fuentes abiertas. En algunos casos, se usan datos no disponibles en fuentes abiertas con el objetivo de reorientar las investigaciones o recolectar más evidencias.